[AI] vLLM 部署地端模型系統訊息記錄 A100

2025 年八月釋出的 GPT-OSS-20B 是普遍地端採用的模型,一釋出的時候就有 128K 的 max-model-len,2026 年四月 Google Gemma-4 上下文大小更可以到兩倍,本篇因為工作需要,需要嘗試使用 Gemma-4 模型,因此順便記錄不同地端 (GPT-OSS-20B, Gemma-4) LLM 模型在 Nvidia A100 上配合不同參數的系統訊息,藉此讓自己理解不同 LLM Model 與配合 A100 產生的差異,提供一個低成本的解決方案。

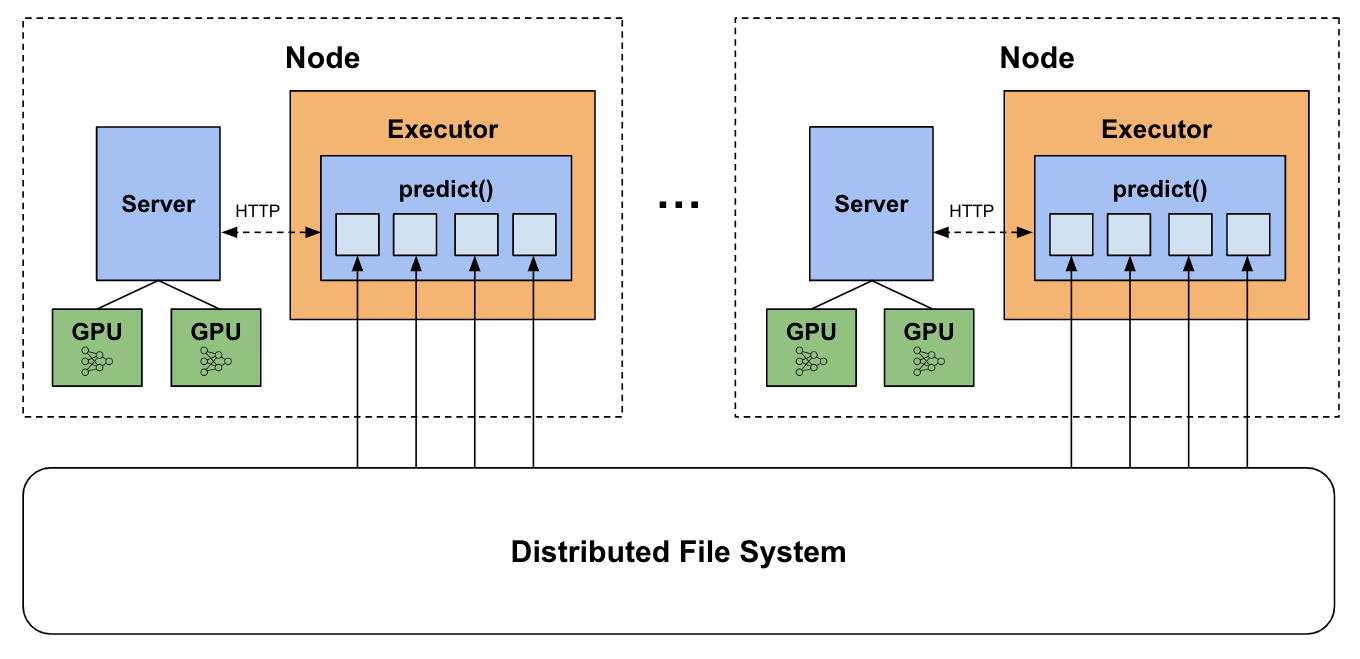

詳細內容